Sechs Regeln für KI-Agenten

Künstliche Intelligenz wird zunehmend selbstständig. Ob in der Produktion, in der Logistik oder in internen Prozessen: Immer häufiger treffen KI-Agenten Entscheidungen, die konkrete Handlungen auslösen. Um Fehler und Missbrauch zu vermeiden, braucht es klare Regeln. Hersteller Augmentir beschreibt hier sechs zentrale Leitlinien.

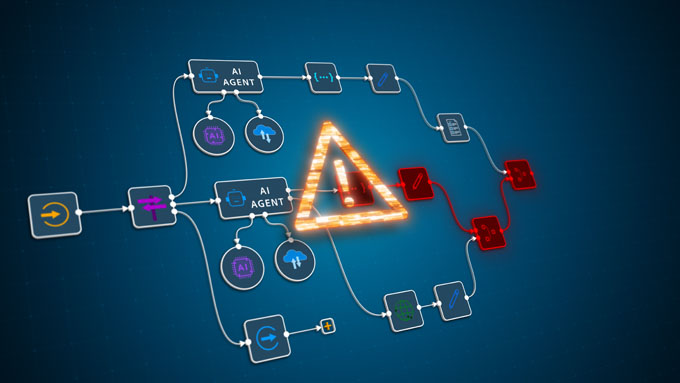

KI-Agenten verändern die Art und Weise, wie Unternehmen arbeiten. Sie übernehmen Routineaufgaben, analysieren Daten und liefern Handlungsempfehlungen – oft in Echtzeit. So erwartet das Analystenhaus Gartner, dass 2028 mindestens 15 Prozent der Entscheidungen, die routinemässig in einem Unternehmen anfallen, autonom von KI-Agenten getroffen werden. Je mehr deren Bedeutung und Verbreitung zunehmen, desto mehr steigen jedoch auch die Risiken. Denn kleine Anfangsfehler oder intransparente Prozesse können sich schnell zu grösseren Schäden ausweiten, wenn das Korrektiv fehlt.

Augmentir kennt diese Herausforderungen aus erster Hand. Denn der Hersteller einer KI-basierten Plattform für Connected Worker arbeitet eng mit weltweit führenden Industriebetrieben zusammen. Das Unternehmen hat deshalb die «6 Regeln für KI-Agenten» entwickelt: praxisnahe Leitlinien, die sicherstellen, dass KI-Systeme transparent, verantwortungsbewusst und verlässlich funktionieren. Wer diese Prinzipien beachtet, kann das volle Potenzial der neuen technologischen Möglichkeiten nutzen, ohne das Vertrauen von Kunden und Mitarbeitern zu gefährden.

1. Transparenz bei der Ausführung

Jede Aktivität eines KI-Agenten muss nachvollziehbar sein: Welche Anweisungen wurden gegeben? Welche Tools kamen zum Einsatz? Welche Ergebnisse wurden erzielt? – Nur wenn alle Schritte eindeutig dokumentiert sind, lassen sich seine Entscheidungen prüfen und verstehen. KI darf also niemals eine «Black Box» sein. Transparenz schafft Vertrauen und Verbindlichkeit.

2. Klare Verantwortungs- und Zuständigkeitsverhältnisse

Jeder KI-Agent benötigt eine Instanz, die für die Entscheidungen der Technologie einsteht. Diese Aufgabe kann entweder ein Mensch übernehmen oder eine organisatorische Einheit. Deren Zuständigkeiten und Pflichten wiederum müssen eindeutig geregelt sein. Erst dadurch bleibt jederzeit ersichtlich, wer die Kontrolle hat. So leistungsstark KI auch ist oder zukünftig sein wird: Die Verantwortung liegt immer bei den Menschen, nicht bei den Maschinen.

3. Offenlegung der KI-Herkunft

Wenn ein Agent Empfehlungen oder Entscheidungen liefert, muss er unmissverständlich darüber informieren, dass diese von einer KI stammen. Hier bedarf es des expliziten Hinweises: «Fehler sind nicht auszuschliessen». Dies beugt überhöhten Erwartungen ebenso vor wie einer zu grossen Abhängigkeit von KI. Somit bleibt das menschliche Urteilsvermögen im Mittelpunkt.

4. Lückenlose Dokumentation von KI-Beteiligung

Nicht selten werden KI-generierte Empfehlungen oder Inhalte auf anderen Plattformen geteilt – etwa in Microsoft Teams oder internen Portalen. Auch dann dürfen die Angaben zur KI-Quelle sowie entsprechende Disclaimer nicht unter den Tisch fallen. Sämtliche Hinweise müssen zusammen mit dem Inhalt weitergegeben werden: unabhängig davon, wo dieser geteilt wird. Plattformübergreifende Transparenz ist das A und O.

5. Je mehr Wirkung, desto mehr menschliche Kontrolle

KI kann und soll Empfehlungen aussprechen. Doch sobald Massnahmen reale Auswirkungen haben, muss ein Mensch die Entscheidung prüfen und genehmigen. Beispiele dafür sind etwa ein qualitativer Mangel an einem Produkt oder die Meldung eines Sicherheitsvorfalls an einer Anlage. Kurz gesagt: KI darf zwar unterstützen. Wo ihre Handlungen aber zu erheblichen wirtschaftlichen oder persönlichen Konsequenzen führen, ist humane Aufsicht erforderlich.

6. Keine generative KI bei Gefahr für Leib und Leben

Überall dort, wo Menschen zu Schaden kommen können, gibt es klare No-Gos. In sicherheitskritischen Bereichen mit potenziell lebensgefährlichen Folgen sollten generative KI-Agenten nach heutigem Stand nicht autonom steuernd eingreifen. Diese Massnahmen erfordern ein festgelegtes, überprüfbares Vorgehen und strenge Sicherheitsprotokolle. Sich nur auf statistische Wahrscheinlichkeiten der Algorithmen zu verlassen, reicht hier nicht aus. Entsprechende Entscheidungen müssen Fachleuten vorbehalten bleiben.

Fazit: Für eine verantwortungsvolle Zukunft

Der gewissenhafte Umgang mit Künstlicher Intelligenz erfordert klare Leitplanken: Transparenz, menschliche Kontrolle und verbindliche Sicherheitsregeln. Auch der Gesetzgeber hat das erkannt und mit dem EU AI Act verbindliche Mindestanforderungen für den Einsatz von KI formuliert. Wer solche Vorgaben fest verankert, sorgt nicht nur für Compliance, sondern stärkt das Vertrauen von Mitarbeitenden, Partnern und Kunden. «Wir sind der festen Überzeugung, dass KI die menschliche Intelligenz ergänzen und nicht ersetzen sollte. Damit dieser Grundsatz gewahrt bleibt, braucht es verbindliche Regeln», sagt Carsten Hunfeld, Director EMEA von Augmentir, und ergänzt: «Nur so lässt sich KI heute und in Zukunft effizient und mit kalkulierbarem Risiko nutzen.»

Quelle: Augmentir