Sei regole per gli agenti di intelligenza artificiale

L'intelligenza artificiale sta diventando sempre più autonoma. Che si tratti di produzione, logistica o processi interni: Gli agenti di intelligenza artificiale prendono sempre più spesso decisioni che innescano azioni specifiche. Sono necessarie regole chiare per evitare errori e usi impropri. Il produttore Augmentir descrive qui sei linee guida fondamentali.

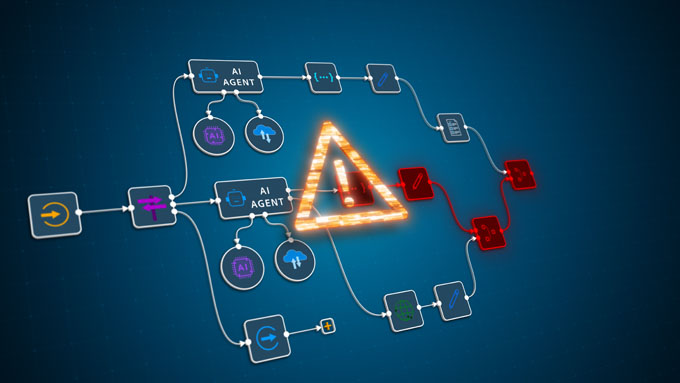

Gli agenti di intelligenza artificiale stanno cambiando il modo di lavorare delle aziende. Si occupano di attività di routine, analizzano i dati e forniscono raccomandazioni per l'azione, spesso in tempo reale. La società di analisi Gartner prevede che entro il 2028 almeno il 15% delle decisioni di routine in un'azienda saranno prese autonomamente da agenti di IA. Tuttavia, quanto più importanti e diffusi diventano, tanto maggiori sono i rischi. Infatti, piccoli errori iniziali o processi non trasparenti possono rapidamente degenerare in danni gravi se non si interviene.

Augmentir conosce queste sfide in prima persona. Infatti, l'azienda produttrice di una piattaforma basata sull'IA per i lavoratori connessi lavora a stretto contatto con le principali aziende industriali di tutto il mondo. Per questo motivo, l'azienda ha sviluppato le «6 regole per gli agenti AI»: linee guida pratiche che assicurano che i sistemi AI funzionino in modo trasparente, responsabile e affidabile. Chi si attiene a questi principi può sfruttare tutto il potenziale delle nuove possibilità tecnologiche senza mettere a rischio la fiducia di clienti e dipendenti.

1. trasparenza nell'esecuzione

Ogni attività di un agente di IA deve essere tracciabile: Quali istruzioni sono state impartite? Quali strumenti sono stati utilizzati? Quali risultati sono stati raggiunti? - Solo se tutti i passaggi sono chiaramente documentati, le sue decisioni possono essere esaminate e comprese. L'IA non deve quindi mai essere una «scatola nera». La trasparenza crea fiducia e impegno.

2. chiare linee di responsabilità e autorità

Ogni agente di IA ha bisogno di un'autorità che garantisca le decisioni della tecnologia. Questo compito può essere svolto da un essere umano o da un'unità organizzativa. Le loro responsabilità e i loro compiti devono essere chiaramente definiti. Solo così sarà chiaro chi ha il controllo in ogni momento. Per quanto l'intelligenza artificiale sia potente o lo sarà in futuro: La responsabilità è sempre delle persone, non delle macchine.

3. divulgazione dell'origine dell'IA

Se un agente fornisce raccomandazioni o decisioni, deve dichiarare chiaramente che queste provengono da un'IA. Ciò richiede l'affermazione esplicita: «Non si possono escludere errori». In questo modo si evitano aspettative eccessive e un'eccessiva dipendenza dall'IA. Il giudizio umano rimane quindi al centro dell'attenzione.

4. documentazione completa della partecipazione all'IA

Non è raro che le raccomandazioni o i contenuti generati dall'IA vengano condivisi su altre piattaforme, ad esempio in Microsoft Teams o nei portali interni. Anche in questo caso, le informazioni sulla fonte dell'IA e le relative dichiarazioni di non responsabilità non devono essere dimenticate. Tutti i riferimenti devono essere trasmessi insieme al contenuto, indipendentemente da dove viene condiviso. La trasparenza multipiattaforma è l'elemento fondamentale.

5 Maggiore è l'impatto, maggiore è il controllo umano

L'intelligenza artificiale può e deve formulare raccomandazioni. Tuttavia, non appena le misure hanno un impatto reale, un umano deve rivedere e approvare la decisione. Esempi di questo tipo sono un difetto qualitativo in un prodotto o la segnalazione di un incidente di sicurezza in un impianto. In breve: l'IA può fornire un supporto. Tuttavia, quando le sue azioni portano a conseguenze economiche o personali significative, è necessaria la supervisione umana.

6. nessuna IA generativa in caso di pericolo per la vita e l'incolumità fisica.

Ci sono chiare situazioni di divieto in cui le persone potrebbero essere danneggiate. Allo stato attuale, gli agenti di intelligenza artificiale generativa non dovrebbero intervenire autonomamente in aree critiche per la sicurezza con conseguenze potenzialmente letali. Queste misure richiedono una procedura definita e verificabile e protocolli di sicurezza rigorosi. Non è sufficiente affidarsi alle sole probabilità statistiche degli algoritmi. Tali decisioni devono essere riservate agli esperti.

Conclusione: per un futuro responsabile

L'uso coscienzioso dell'intelligenza artificiale richiede linee guida chiare: trasparenza, controllo umano e regole di sicurezza vincolanti. Anche i legislatori lo hanno riconosciuto e hanno formulato requisiti minimi vincolanti per l'uso dell'IA con la legge europea sull'IA. Chi stabilisce con fermezza tali requisiti non solo garantisce la conformità, ma rafforza anche la fiducia di dipendenti, partner e clienti. «Crediamo fermamente che l'IA debba integrare l'intelligenza umana e non sostituirla. Per garantire il rispetto di questo principio sono necessarie regole vincolanti», afferma Carsten Hunfeld, Direttore EMEA di Augmentir, che aggiunge: «Solo così l'IA potrà essere utilizzata in modo efficiente e con rischi calcolabili, sia ora che in futuro».»

Fonte: Aumentare