Six règles pour les agents IA

L'intelligence artificielle devient de plus en plus autonome. Que ce soit dans la production, la logistique ou les processus internes : Les agents IA prennent de plus en plus souvent des décisions qui déclenchent des actions concrètes. Pour éviter les erreurs et les abus, il faut des règles claires. Le fabricant Augmentir décrit ici six lignes directrices centrales.

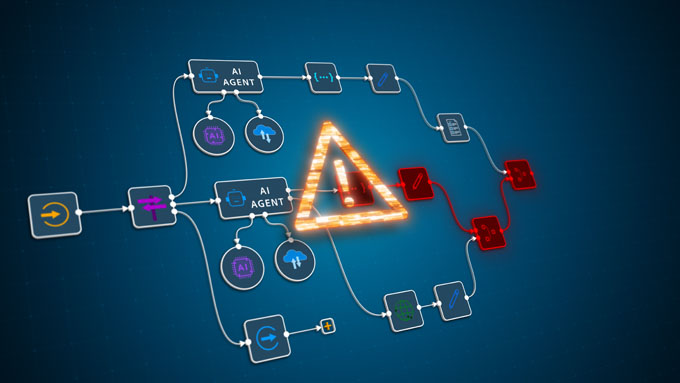

Les agents IA changent la façon dont les entreprises travaillent. Ils prennent en charge les tâches de routine, analysent les données et fournissent des recommandations d'action - souvent en temps réel. Le cabinet d'analystes Gartner s'attend ainsi à ce qu'en 2028, au moins 15% des décisions de routine d'une entreprise soient prises de manière autonome par des agents IA. Cependant, plus leur importance et leur diffusion augmentent, plus les risques augmentent également. En effet, de petites erreurs de départ ou des processus peu transparents peuvent rapidement se transformer en dommages plus importants si le correctif fait défaut.

Augmentir connaît ces défis de première main. En effet, le fabricant d'une plateforme basée sur l'IA pour les travailleurs connectés travaille en étroite collaboration avec des entreprises industrielles de premier plan dans le monde entier. L'entreprise a donc développé les «6 règles pour les agents de l'IA» : des lignes directrices pratiques qui garantissent que les systèmes d'IA fonctionnent de manière transparente, responsable et fiable. En respectant ces principes, on peut exploiter tout le potentiel des nouvelles possibilités technologiques sans mettre en péril la confiance des clients et des collaborateurs.

1. transparence dans l'exécution

Chaque activité d'un agent IA doit être traçable : Quelles instructions ont été données ? Quels outils ont été utilisés ? Quels résultats ont été obtenus ? - Ce n'est que lorsque toutes les étapes sont clairement documentées que ses décisions peuvent être vérifiées et comprises. L'IA ne doit donc jamais être une «boîte noire». La transparence est source de confiance et d'engagement.

2. une répartition claire des responsabilités et des compétences

Chaque agent IA a besoin d'une instance qui se porte garante des décisions prises par la technologie. Cette tâche peut être assumée soit par un être humain, soit par une unité organisationnelle. Les compétences et les obligations de cette dernière doivent être clairement définies. Ce n'est qu'ainsi qu'il est possible de savoir à tout moment qui a le contrôle. Aussi puissante que soit l'IA ou qu'elle le sera à l'avenir : La responsabilité incombe toujours aux hommes et non aux machines.

3. divulgation de l'origine de l'IA

Lorsqu'un agent fournit des recommandations ou des décisions, il doit informer sans équivoque que celles-ci proviennent d'une IA. Il est nécessaire d'indiquer explicitement que «des erreurs ne sont pas exclues». Cela permet d'éviter des attentes excessives ainsi qu'une trop grande dépendance vis-à-vis de l'IA. Ainsi, la capacité de jugement humaine reste au centre des préoccupations.

4. documentation complète sur la participation à l'IA

Il n'est pas rare que des recommandations ou des contenus générés par l'IA soient partagés sur d'autres plateformes - par exemple dans Microsoft Teams ou sur des portails internes. Même dans ce cas, les informations sur la source de l'IA et les clauses de non-responsabilité correspondantes ne doivent pas être oubliées. Toutes les mentions doivent être transmises avec le contenu, quel que soit l'endroit où il est partagé. La transparence multiplateforme est essentielle.

5. plus il y a d'impact, plus il y a de contrôle humain

L'IA peut et doit émettre des recommandations. Mais dès que des mesures ont un impact réel, un être humain doit examiner et approuver la décision. Des exemples sont par exemple un défaut qualitatif d'un produit ou la notification d'un incident de sécurité sur une installation. En bref : l'IA peut certes apporter son soutien. Mais lorsque ses actions ont des conséquences économiques ou personnelles importantes, une supervision humaine est nécessaire.

6. pas d'IA générative en cas de danger pour la vie ou l'intégrité corporelle

Partout où des personnes peuvent être blessées, il y a clairement des "no-go". En l'état actuel des choses, les agents IA génératifs ne devraient pas intervenir de manière autonome dans des domaines critiques en termes de sécurité, avec des conséquences potentiellement mortelles. Ces mesures requièrent une procédure définie et vérifiable ainsi que des protocoles de sécurité stricts. Se fier uniquement aux probabilités statistiques des algorithmes ne suffit pas ici. Les décisions correspondantes doivent être réservées à des spécialistes.

Conclusion : pour un avenir responsable

L'utilisation consciencieuse de l'intelligence artificielle nécessite des garde-fous clairs : transparence, contrôle humain et règles de sécurité contraignantes. Le législateur l'a également reconnu et a formulé des exigences minimales contraignantes pour l'utilisation de l'IA avec le EU AI Act. Celui qui ancre solidement de telles prescriptions ne veille pas seulement à la conformité, mais renforce la confiance des collaborateurs, des partenaires et des clients. «Nous sommes fermement convaincus que l'IA doit compléter l'intelligence humaine et non la remplacer. Pour que ce principe soit respecté, il faut des règles contraignantes», déclare Carsten Hunfeld, directeur EMEA d'Augmentir, avant d'ajouter : «C'est la seule façon d'utiliser l'IA efficacement et avec des risques calculables, aujourd'hui et à l'avenir».»

Source : Augmentir